La inteligencia artificial ya no es solo una herramienta tecnológica. Se ha convertido en un factor estructural de poder que redefine la seguridad y la defensa. En este artículo, Irene García, alumna del Máster Profesional de Ciberseguridad, Ciberinteligencia y Ciberdefensa de LISA Institute, analiza cómo su convergencia con la biotecnología y la neurociencia transformará los conflictos hacia 2040-2050.

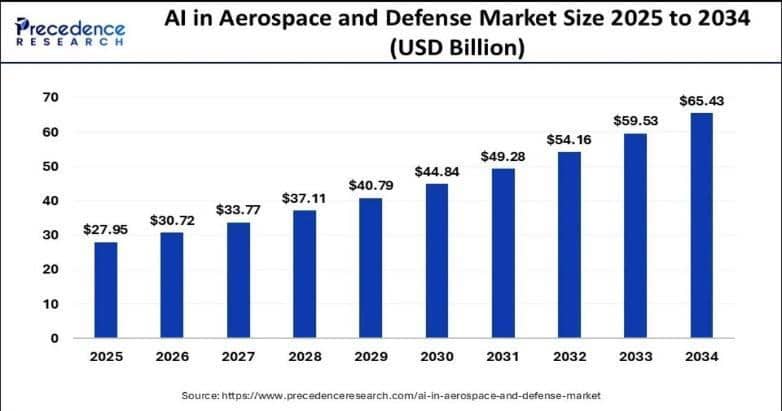

La aceleración del desarrollo de la inteligencia artificial se produce en un contexto internacional caracterizado por la fragmentación del orden liberal, la intensificación de la rivalidad entre grandes potencias y la proliferación de amenazas híbridas. En este entorno, la IA no actúa únicamente como una tecnología facilitadora, sino como un factor estructurante del poder, comparable en impacto histórico a la pólvora, la energía nuclear o Internet.

A diferencia de revoluciones tecnológicas anteriores, la IA posee una característica distintiva: su capacidad de aprendizaje autónomo y escalabilidad exponencial, lo que dificulta su control normativo y multiplica los efectos no intencionados. Esto obliga a los Estados y organizaciones internacionales a replantear conceptos clásicos como disuasión, superioridad militar, soberanía tecnológica y control de armamentos.

➡️ Te puede interesar: Economía digital y ciberseguridad: un binomio clave para la dirección financiera

Desde la perspectiva prospectiva, el horizonte 2040-2050 no debe entenderse como una fecha lejana, sino como un punto de convergencia de tendencias ya visibles hoy: automatización del ciclo de inteligencia, delegación progresiva de decisiones críticas a sistemas algorítmicos y creciente dependencia de infraestructuras digitales vulnerables. La anticipación estratégica se convierte, por tanto, en un elemento central de la seguridad nacional.

Inteligencia artificial como multiplicador estratégico

La IA reconfigura los cuatro pilares de la seguridad:

- Inteligencia: algoritmos de análisis masivo convierten la información en predicciones accionables. El coronel D. Javier Nievas, (Nievas, 2023) en su docencia en HUMINT en LISA Institute, enfatiza que la fusión entre IA y la inteligencia humana será la clave de la detección temprana. La incorporación de la IA al ciclo de inteligencia transforma radicalmente las fases de obtención, análisis y difusión. La explotación de grandes volúmenes de datos abiertos, sensores, redes sociales y fuentes técnicas permite identificar patrones débiles que escaparían al análisis humano tradicional.

- Sin embargo, esta aparente superioridad analítica encierra riesgos críticos: sesgos algorítmicos, manipulación de datos de entrenamiento y dependencia excesiva de sistemas opacos (black box systems). Por ello, la inteligencia del futuro no será puramente artificial ni puramente humana, sino una inteligencia híbrida, donde la validación contextual, cultural y ética seguirá siendo responsabilidad del analista humano.

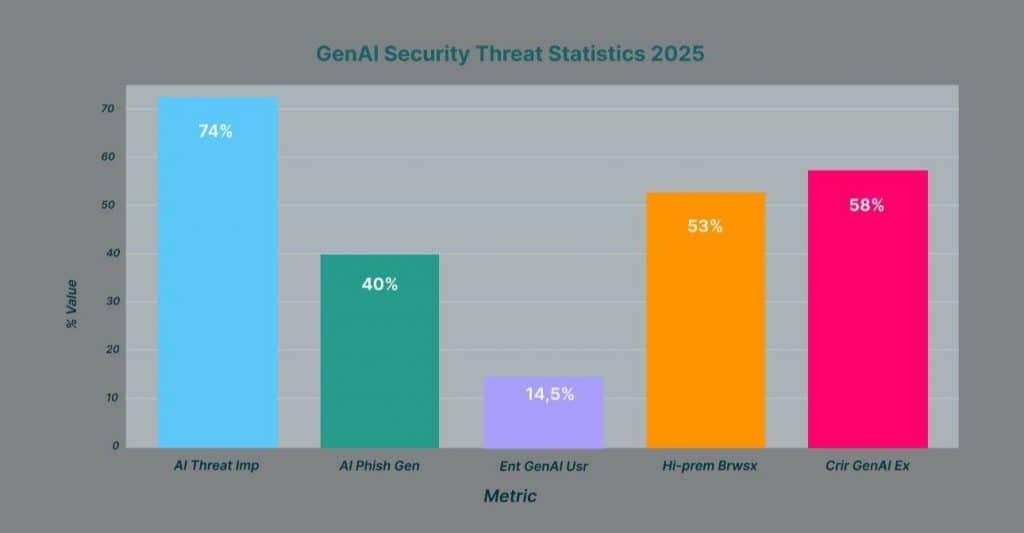

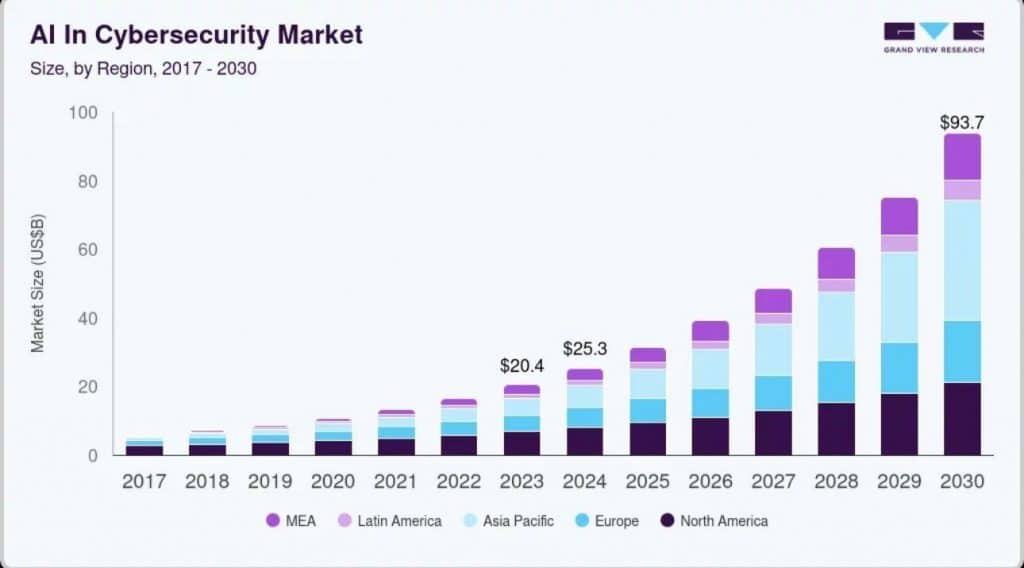

- Defensa cibernética: IA entrenada para anticipar ataques invisibles antes de que afecten a infraestructuras críticas. En este ámbito, la IA introduce una dinámica de confrontación permanente y automatizada. Los ataques y defensas evolucionan en tiempo real, reduciendo el umbral de entrada al conflicto y difuminando la distinción entre tiempos de paz y guerra.

- La protección de infraestructuras críticas -energía, transporte, salud, finanzas- dependerá cada vez más de sistemas de IA capaces de detectar anomalías antes de que se materialicen los efectos físicos. No obstante, esta dependencia genera una paradoja: cuanto más sofisticada es la defensa algorítmica, mayor es el impacto potencial de su fallo o compromiso.

- Operaciones militares: decisiones algorítmicas reducen segundos vitales en combate, aunque sin control humano el riesgo ético y estratégico es inmenso. La automatización de funciones tácticas y operativas modifica profundamente la naturaleza del combate. En los conflictos futuros, la superioridad no se medirá únicamente en plataformas o armamento, sino en la calidad del software, los datos y los modelos de decisión.

- Los sistemas autónomos permitirán operar en entornos negados, saturados o altamente letales, reduciendo la exposición humana directa. Sin embargo, también incrementan el riesgo de escaladas no intencionadas, especialmente cuando dos sistemas algorítmicos adversarios interactúan sin mediación humana.

➡️ Te puede interesar: ¿Qué es el cibercrimen y cómo protegerse?

- Narrativas y legitimidad: como enseña el coronel D. Juan Bustamante, (Bustamante, 2024) experto en comunicación estratégica, la IA puede amplificar campañas de desinformación y moldear percepciones públicas. El dominio cognitivo emerge como un campo de batalla decisivo. La IA permite personalizar mensajes, amplificar emociones y erosionar la confianza institucional a gran escala. La manipulación informativa deja de ser masiva para convertirse en micro dirigida, adaptada a perfiles psicológicos individuales.

- La legitimidad política y social se convierte así en un objeto estratégico. La capacidad de influir en percepciones puede ser tan decisiva como el control del terrorismo físico, especialmente en democracias abiertas.

Más allá de su impacto sectorial, la IA actúa como un multiplicador transversal que interconecta dominios tradicionalmente separados. La inteligencia artificial no sustituye capacidades existentes, sino que redefine su velocidad, alcance y profundidad, alterando la relación entre información, decisión y acción.

En términos estratégicos, la IA comprime el tiempo. La denominada decision-making advantage se convierte en un factor crítico: quien procese antes, comprenda mejor y actúe más rápido obtendrá una ventaja decisiva, incluso frente a adversarios numéricamente superiores. Esto introduce una presión estructural hacia la automatización, con el riesgo inherente de reducir los márgenes de control humano.

Asimismo, la integración de la IA en sistemas de mando y control plantea dilemas doctrinales: ¿hasta qué punto permitirse que un algoritmo priorice objetivos, asigne recursos o recomiende respuestas letales? La tensión entre eficacia operativa y responsabilidad política se intensifica, especialmente en escenarios de alta ambigüedad o escalada rápida.

Escenarios prospectivos de la inteligencia artificial (2040-2050)

Escenario 1 – Gobernanza algorítmica cooperativa (optimista):

Se establece un Tratado de Ginebra Digital(Tratado de Ginebra, 1949) que regula armas autónomas y algoritmos militares. La IA se convierte en un instrumento de cooperación multilateral.

Escenario 2 – Conflictos algorítmicos (intermedio):

Las potencias despliegan IA para competir en ciberespacio, espacio ultraterrestre y biotecnología. Los ejércitos libran “guerras invisibles” entre algoritmos más que entre soldados.

Escenario 3 – Ruptura bio-digital (pesimista):

La convergencia de IA, biotecnología y computación cuántica abre riesgos sin precedentes: manipulación genética dirigida por IA, encriptación obsoleta y colapso de sistemas críticos.

Los tres escenarios planteados no son excluyentes, sino trayectorias coexistentes. Es probable que el sistema internacional experimente simultáneamente cooperación normativa limitada, competencia estratégica intensa y rupturas disruptivas en sectores específicos.

➡️ Te puede interesar: Protección de datos personales: cómo mantener tu información segura en línea

La gobernanza algorítmica cooperativa podría avanzar en ámbitos concretos (transparencia, ética, auditoría), mientras que la carrera por la superioridad tecnológica continúe sin freno en otros dominios. Esta asimetría generará zonas grises de regulación y espacios de oportunidad para actores estatales y no estatales.

Riesgos y oportunidades de la inteligencia artificial

Riesgos clave:

- Armas autónomas sin control humano.

- Dependencia tecnológica de proveedores extranjeros.

- Manipulación informativa algorítmica y polarización social.

- Amenazas híbridas bio-digitales.

Oportunidades:

- Refuerzo de la resiliencia nacional.

- Capacidad predictiva en migraciones, terrorismo o ciberataques.

- Mayor cooperación internacional en auditorías algorítmicas.

Como advierte Pedro Baños, profesor y geoestratega, «La batalla del futuro se librará en torno al control de los datos y de los cerebros» (Baños, 2021).

El principal riesgo estratégico no reside únicamente en el uso malicioso de la IA, sino en la asimetría de capacidades. Estados, empresas y grupos con acceso privilegiado a datos, talento y computación concentrará poder de forma desproporcionada.

Al mismo tiempo, la IA ofrece oportunidades para Estados medianos que adopten estrategias inteligentes de especialización, cooperación y regulación avanzada. La clave no será competir en volumen, sino en calidad institucional, ética y resiliencia.

Formación y aplicabilidad: el papel de LISA Institute

La prospectiva sólo es útil si se convierte en competencia aplicada. En este sentido, en LISA Institute ha estructurado programas que preparan a los profesionales para escenarios de alta incertidumbre:

- HUMINT y Contrainteligencia (D. Javier Nievas): cómo integrar la inteligencia humana con algoritmos para anticipar amenazas híbridas.

- Comunicación Estratégica (D. Juan Bustamante): técnicas para contrarrestar campañas de desinformación potenciadas por IA.

- Ciberinteligencia y Prospectiva: cursos de especialistas en terrorismo, criminología y ciberseguridad que abordan directamente el impacto de la IA en infraestructuras críticas.

- Geopolítica y Seguridad Internacional (Pedro Baños): análisis de rivalidades sistémicas (EE.EE.-China-Rusia) y su relación con tecnologías disruptivas. (Este último con libros y análisis para el trabajo autónomo).

➡️ Te puede interesar: El día que el genio salió de la lámpara: un análisis sobre inteligencia artificial y geopolítica

Estos módulos constituyen un ecosistema formativo que permite aplicar la prospectiva a casos reales, desde la protección de fronteras hasta la anticipación de ciberataques. La formación en IA aplicada a seguridad no debe limitarse al dominio técnico. Requiere una aproximación integral que combine análisis estratégico, ética, derecho internacional y comprensión sociopolítica.

El profesional del futuro deberá ser capaz de dialogar con ingenieros, decisores políticos y operadores sobre una base conceptual. La prospectiva aplicada permite transformar la incertidumbre en ventaja competitiva, siempre que se traduzca en doctrina, procedimientos y capacidades reales.

Recomendaciones estratégicas

1.- Defensa Algorítmica Híbrida: integrar IA, HUMINT, ciberseguridad y bioseguridad en una doctrina nacional.

2.- Observatorio Algorítmico Internacional: con participación de centros como LISA y Elcano (entre otras), para auditar riesgos futuros.

3.- Formación ética y técnica: consolidar másteres y cursos especializados en IA aplicada a defensa y derechos humanos.

4.- Diplomacia tecnológica: liderar propuestas de tratados internacionales que regulen la IA militar.

5.- Resiliencia ciudadana: educar a la sociedad en riesgos de desinformación y manipulación algorítmica.

Las recomendaciones propuestas deben entenderse como un marco dinámico, adaptable a la evolución tecnológica. La creación de observatorios algorítmicos y la diplomacia tecnológica no son objetivos finales, sino procesos continuos que requieren cooperación internacional sostenida y voluntad política.

Conclusiones: inteligencia artificial y convergencia bio-digital

La innovación tecnológica con mayor impacto en seguridad y defensa hacia 2040-2050 será la convergencia de inteligencia artificial con biotecnología y neurociencia aplicada. No hablamos únicamente de máquinas más inteligentes, sino de un entramado bio-digital capaz de transformar la naturaleza misma de los conflictos.

La IA cuántica permitirá procesar y descifrar en segundo lugar lo que hoy requiere años, rompiendo el paradigma de la encriptación y generando un nuevo espacio de vulnerabilidad. La biotecnología, asistida por algoritmos, abrirá la puerta a patógenos diseñados con precisión o a terapias selectivas aplicables tanto a la salud como a la guerra biológica. La neurociencia, combinada con IA, dará lugar a interfaces cerebro-máquina que expandirá la ciberguerra hasta el terreno cognitivo, donde el control de percepciones y emociones será tan decisivo como el control territorial.

Esta convergencia representa un cisne negro anunciado: sabemos que su desarrollo es inevitable, pero subestimamos su velocidad y magnitud. La prospectiva nos alerta de que la próxima gran revolución en seguridad no será solo tecnológica, sino epistemológica: redefinirá que significa “defensa” cuando los campos de batalla sean invisibles, híbridos y cognitivos.

Aquí radica la urgencia de formar profesionales capaces de anticipar y gestionar estos retos. Todo ello puede conseguirse preparando a futuros analistas en HUMINT, contrainteligencia, comunicación estratégica y geopolítica aplicada. Que, a su vez, se proporcione una dimensión estratégica global que permita situar estos riesgos en el tablero internacional.

En definitiva, la innovación que más transformará la seguridad y la defensa no será una sola tecnología aislada, sino la simbiosis entre IA, biotecnología y neurociencia. Quien domine esa convergencia tendrá la llave no sólo de los ejércitos del futuro sino del poder sobre lo más humano: la vida y la mente.

➡️ Si quieres ser un experto en Ciberseguridad, te recomendamos el siguiente curso formativo: